Anthropic supera i 30 miliardi di run rate e studia chip AI propri: cosa cambia per chi usa Claude

Anthropic ha triplicato il proprio fatturato annualizzato in meno di quattro mesi, superando i 30 miliardi di dollari di run rate. Con questa scala, l’azienda sta valutando la progettazione di chip AI proprietari per ridurre la dipendenza da fornitori esterni. Il progetto è ancora esplorativo — nessun team dedicato né design definitivo — ma la […]

Granite 4.0 3B Vision: IBM batte tutti sulla table extraction — 92,1 TEDS su PubTables, Apache 2.0

IBM rilascia Granite 4.0 3B Vision con un obiettivo dichiarato: estrarre dati strutturati da documenti enterprise meglio di qualsiasi modello compatto disponibile. Il risultato: SOTA su table extraction (92,1 TEDS su PubTablesV2), SOTA su chart understanding (86,4% su Chart2Summary), e 85,5% exact match su form extraction zero-shot. Licenza Apache 2.0, 3B parametri, disponibile su HuggingFace. […]

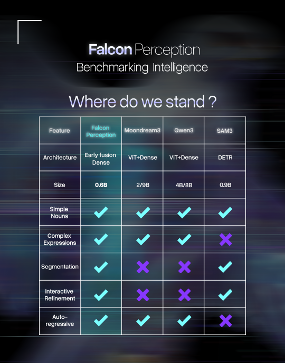

Falcon Perception: 0.6B parametri e batte SAM 3 nel grounding visuale — spatial +21%, OCR-guided +13%

Technology Innovation Institute (TII) rilascia Falcon Perception: un modello di visione da soli 0.6B parametri specializzato in grounding e segmentazione da linguaggio naturale. Su quasi tutti i benchmark batte SAM 3 (Meta) nonostante una dimensione nettamente inferiore — con margini che arrivano a +21,9 punti sulla comprensione spaziale. Cosa fa Falcon Perception Il grounding visuale […]

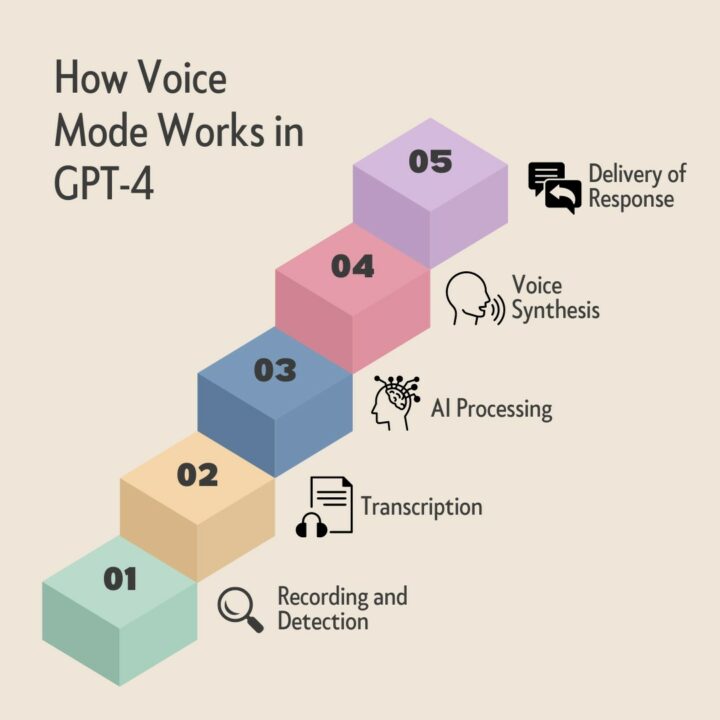

ChatGPT Voice Mode usa un modello con cutoff aprile 2024: quasi due anni di ritardo rispetto al testo

Andrej Karpathy ha messo a fuoco un problema che molti utenti avevano già percepito senza riuscire a quantificarlo: la modalità vocale di ChatGPT usa un modello significativamente più vecchio rispetto alla versione testuale. Se chiedi a ChatGPT voice mode qual è il suo knowledge cutoff, risponde: aprile 2024. Quasi due anni di ritardo rispetto al […]

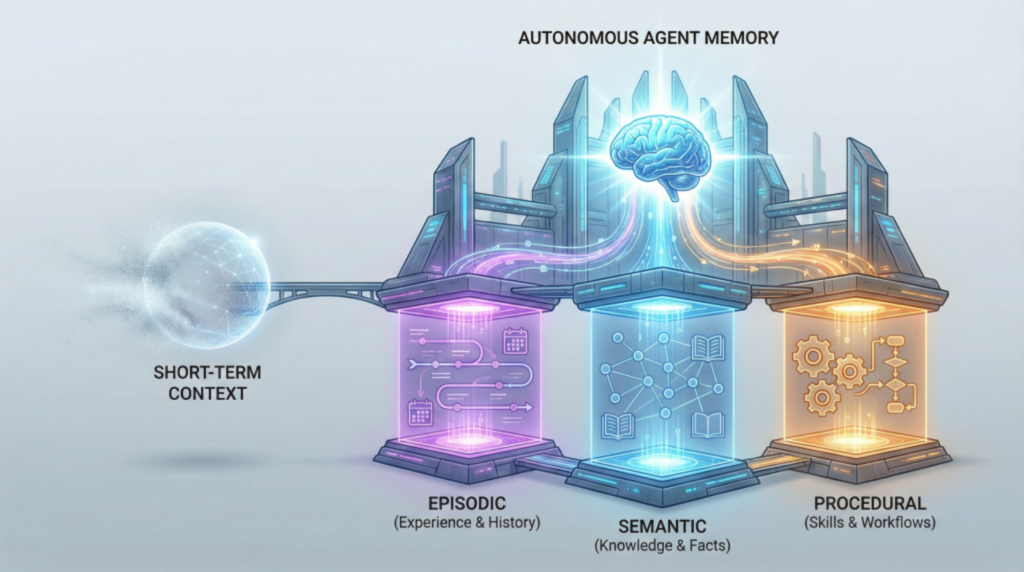

ALTK-Evolve: gli agenti AI che imparano dai propri errori — +14% sui task difficili, si integra con Claude Code

IBM Research pubblica ALTK-Evolve: un sistema di memoria a lungo termine per agenti AI che trasforma le esperienze passate in linee guida riutilizzabili. In pratica, risolve il problema che chiunque ha già incontrato con gli agenti AI — ripetono gli stessi errori perché dimenticano tutto tra una sessione e l’altra. I benchmark: +8,9% aggregate su […]

Waypoint-1.5: mondi 3D interattivi generati in tempo reale dalla tua GPU — RTX 3090 basta

Overworld rilascia Waypoint-1.5, un world model che genera ambienti 3D interattivi in tempo reale direttamente sulla GPU di casa. Non è un gioco, non è un motore grafico — è un modello AI che crea mondi esplorabili generativamente, frame per frame, rispondendo all’input dell’utente. Funziona su RTX 3090 a 720p/60fps. Su laptop gaming standard in […]

Meta Muse Spark: 16 strumenti integrati, #4 al mondo — ma non è open source

Meta ha presentato Muse Spark, il suo nuovo modello AI accessibile via meta.ai — il primo rilascio significativo dopo Llama 4. Score Artificial Analysis: 52, quarto al mondo dietro Gemini 3.1 Pro, GPT-5.4 e Claude Opus 4.6. La particolarità: 16 strumenti integrati nativi, tra cui code interpreter Python, visual grounding e sub-agenti. Il limite: non […]

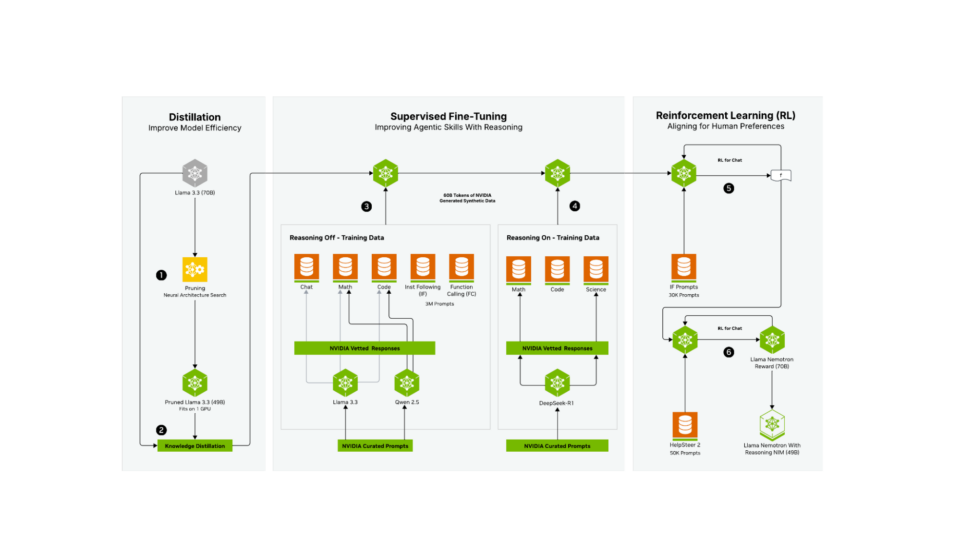

NVIDIA Nemotron-Cascade-2 su Ollama: 30B MoE, 256k context, reasoning e coding — 24 GB download

NVIDIA ha portato Nemotron-Cascade-2 su Ollama: un modello MoE da 30B parametri totali con 3B attivi per token, context window di 256k token e un focus dichiarato su reasoning avanzato e capacità agentiche. Sul piano dei benchmark: gold medal all’IMO 2025 (matematica) e all’IOI 2025 (informatica). 73mila download in due settimane. Specifiche tecniche Architettura: Mixture […]

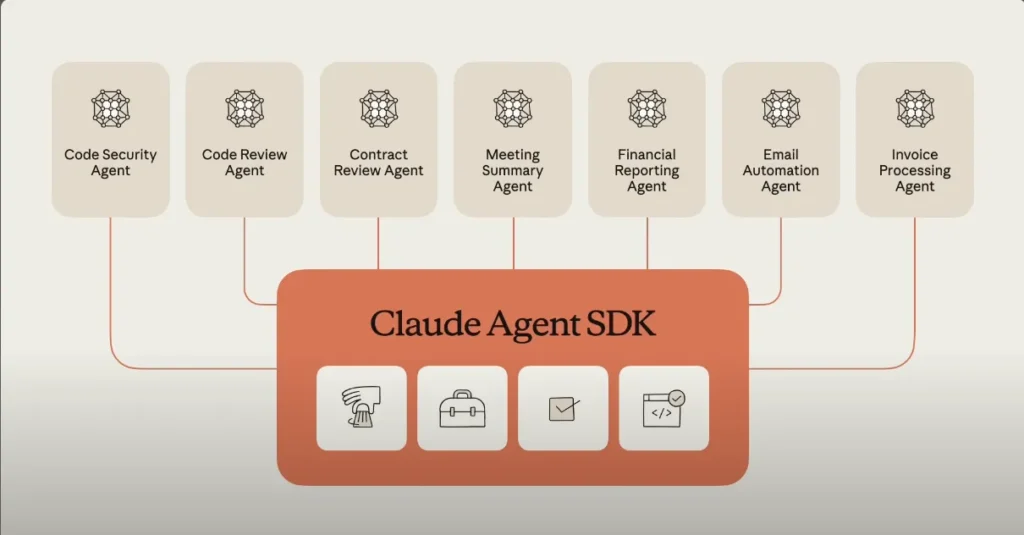

Claude Managed Agents in public beta: Anthropic gestisce sandbox e orchestrazione — ecco cosa cambia

Costruire agenti AI affidabili richiede ore di lavoro che non c’entrano nulla con l’intelligenza del modello: sandbox sicure, state management tra i turn, gestione degli errori di tool, orchestrazione tra più agenti. Anthropic risolve tutto questo con Claude Managed Agents, ora in public beta — disponibile per tutti gli account API senza richiesta separata. Cosa […]

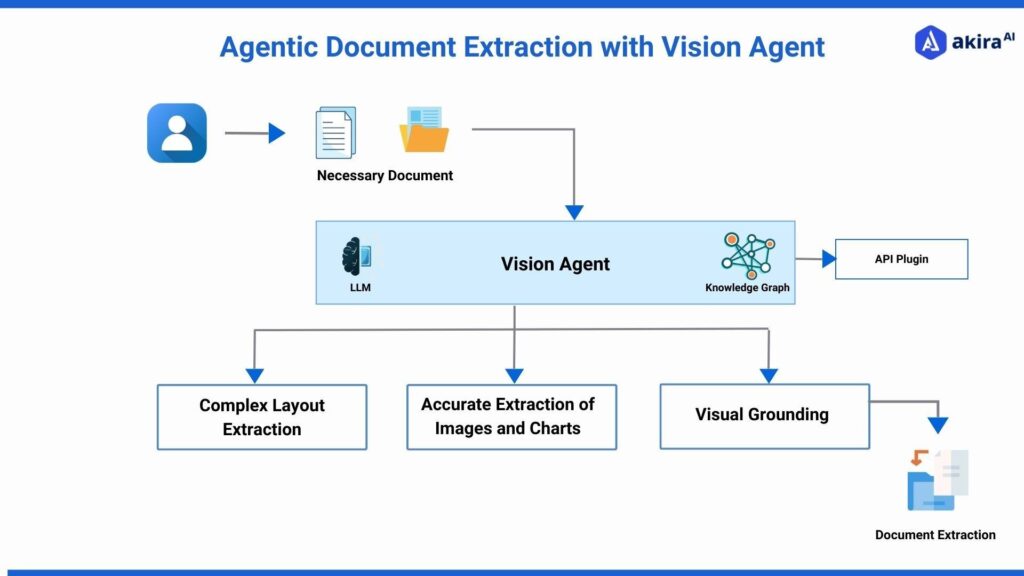

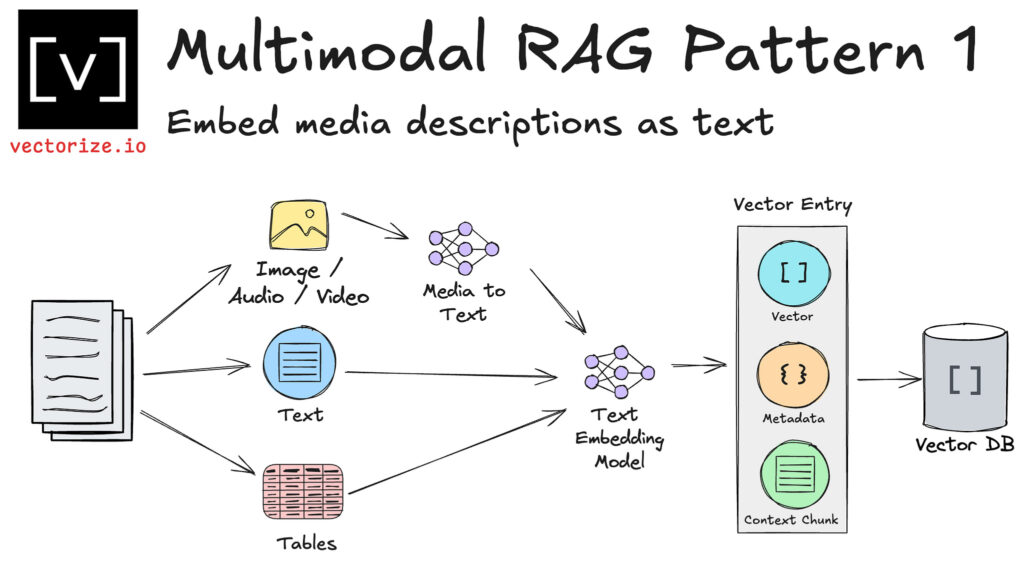

RAG multimodale in locale: guida completa con Sentence Transformers v5.4 e Qwen3-VL

Finora fare RAG su documenti visivi — PDF scansionati, screenshot, slide, immagini di prodotto — richiedeva pipeline complesse con OCR, pre-processing e modelli separati per testo e immagini. Sentence Transformers v5.4 cambia questo: con una singola API puoi creare embedding multimodali su testo, immagini e video, e costruire sistemi di ricerca semantica che funzionano cross-modale. […]